经常在社群媒体上跑跳的人,应该对於「演算法」很熟悉,毕竟每天滑手机的内容几乎都是由演算法推荐,不过若时常依赖演算法所推荐的内容作为唯一的思考面向与价值观,很容易被单一的观点所限制,产生偏差的立场与思考方式。

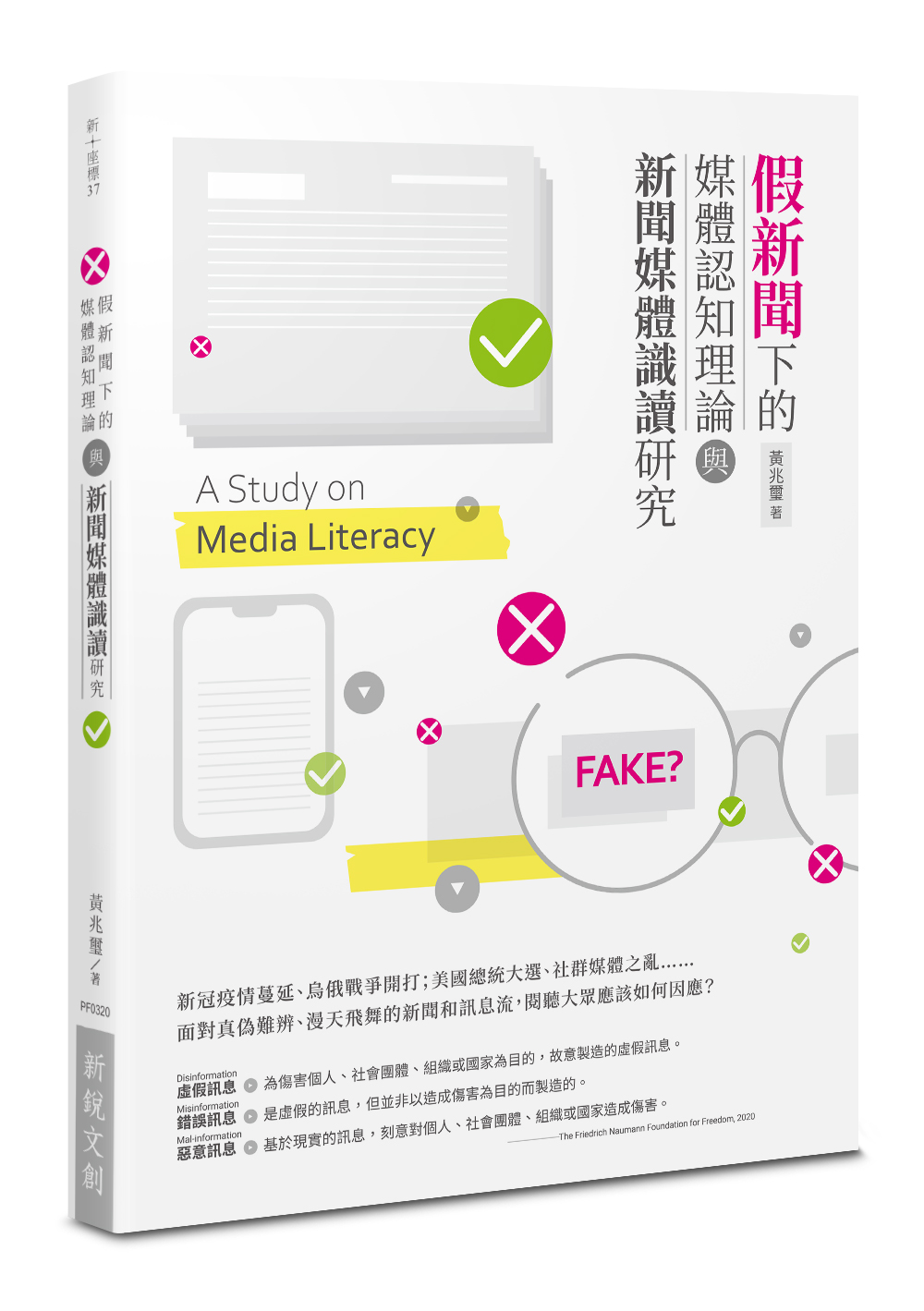

我们该如何在吸收社群媒体的资讯内容时能够不被演算法固定立场,参考多方想法与意见,以及如何拥有媒体识读能力、拥有批判性,不会因为网路上的风吹草动随之起舞呢?

{本文经授权转载自女人迷,首图取自 《社群网战》_IMDb}

性别议题是加剧阅读偏见的主因?

图片来源:《智能社会:进退两难》_IMDb

图片来源:《智能社会:进退两难》_IMDb

在数位时代,人工智慧(AI)已深入我们生活的各个层面。然而,AI应用不当可能会加剧无意识偏见,特别是在性别议题上。

一个引人深思的例子来自社交媒体平台Instagram,一位内容创作者thekingzletter分享了一个有趣的观察:关於「女生抱怨男友迟到」的影片下,男性和女性用户看到的热门评论完全不同。

图片来源:《社群网战》_IMDb

图片来源:《社群网战》_IMDb

女性用户看到的评论多是支持影片中的女生,如:「他不尊重你的时间,分手吧!」、「他有跟你说他会晚到吗?没有的话放生吧!」;而男性用户看到的评论则倾向支持男友,例如:「别整天等他,自己找点事做吧。」、「抱歉喔,我就是那个一起打高尔夫的朋友。」

令人震惊的是,这些言论几乎都是处在对立的视角进行发言。

▌展开第二次工业革命

当代科技随着AI的异军突起,某种意义上来说就像是进入第二次工业革命时期,不论是哪个国家都依赖且关注其动向的局势。

因此,人工智慧逐步扩展的同时,它所能改变的事情也远比人类所想像的多,书中细细说明其所能够改变战争走向、国际安全与人类自由的未来,甚至是如何维持在世界秩序中的领导地位。

该如何在这个充满竞争与被人工智慧包覆的世界存活并占有优势?本书带领读者一窥目前的现况,提供思考新方向。

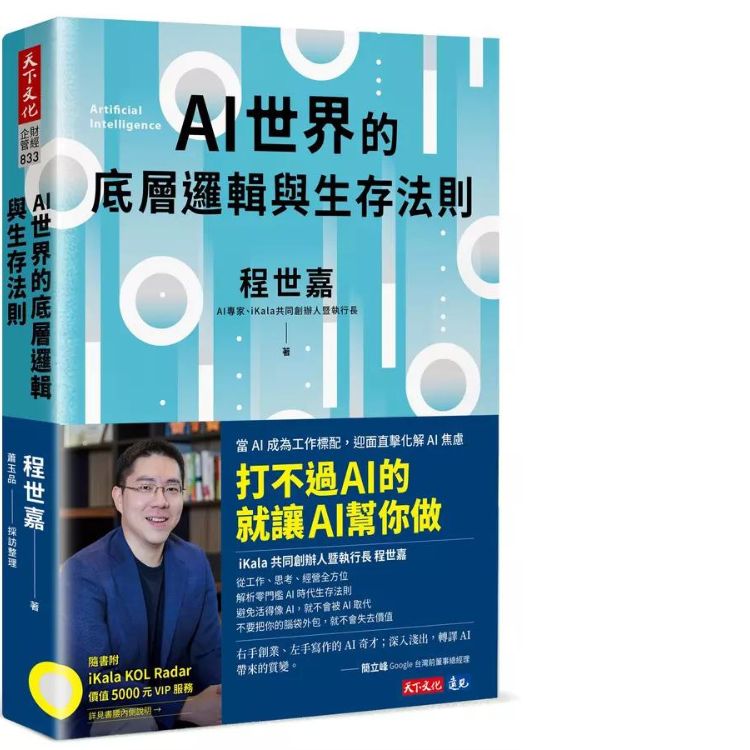

▌AI世界中的生存法则

当AI越来越发达的同时,也有多人担忧工作职位在未来会轻易地被其取代,进而产生焦虑与不安。

但本书作者却不这麽认为,他主张AI是一种便利的工具,因此若已身处在AI的时代,就想尽办法与之共存,打造更高的成果和提升工作效率。

别使这项优秀的辅助工具成为你的焦虑来源,拥有自我主张,不轻易被掌控影响,才能发展只有你能做的能力,并发光发热。

AI演算法带来的影响与後果

图片来源:《智能社会:进退两难》_IMDb

图片来源:《智能社会:进退两难》_IMDb

因此,该篇贴文下有位机器学习研究者分享造成这个现象的原因为协同过滤(collaborative filtering),目的是最大化用户的萤幕使用时间。

AI演算法根据每位用户的使用习惯,显示最可能吸引他们继续浏览的评论。社交软体环境中,协同过滤可能导致用户只看到与自己观点相似的评论。这种机制虽然提高了用户参与度,却也可能强化既有观点,限制多元视角的接触。

图片来源:《社群网战》_IMDb

图片来源:《社群网战》_IMDb

透过此案例的留言现象,我们也发现3点AI演算法会造成的现象如下:

1. 同温层效应(Echo Chamber Effect):用户可能只接收到符合自己既有观点的讯息,减少接触多元观点的机会,可能加剧社会分裂。

2. 固有偏误(inherent bias):如果AI的资料库存在性别或文化偏见,这些偏见可能被无意识地强化和传播。

3. 社会对立:长期的协同过滤与讯息隔离,可能导致不同群体之间的理解和沟通障碍,增加社会对立情绪。

▌看更多女人迷文章

如何不受演算法固定思考模式?

图片来源:《社群网战》_IMDb

图片来源:《社群网战》_IMDb

个人行为上:

定期进行「算法清理」:定期检查并调整社交软体和搜索引擎的设置,如清理浏览历史、重置推荐算法,或使用隐私浏览模式,以减少同温层效应。

组织行为上:

图片来源:《社群网战》_IMDb

图片来源:《社群网战》_IMDb

1. 建立多元共融的AI治理架构与组建多元化的AI开发团队,确保不同背景的人才参与。

2. 制定明确的AI使用DEI指导原则,为员工提无意识偏见培训,提高对潜在偏见的认识。

3. 设立AI伦理委员会或审核小组,实施持续的AI系统DEI评估,分析对不同群体的影响,及时调整系统以确保公平性。