經常在社群媒體上跑跳的人,應該對於「演算法」很熟悉,畢竟每天滑手機的內容幾乎都是由演算法推薦,不過若時常依賴演算法所推薦的內容作為唯一的思考面向與價值觀,很容易被單一的觀點所限制,產生偏差的立場與思考方式。

我們該如何在吸收社群媒體的資訊內容時能夠不被演算法固定立場,參考多方想法與意見,以及如何擁有媒體識讀能力、擁有批判性,不會因為網路上的風吹草動隨之起舞呢?

{本文經授權轉載自女人迷,首圖取自 《社群網戰》_IMDb}

性別議題是加劇閱讀偏見的主因?

圖片來源:《智能社會:進退兩難》_IMDb

圖片來源:《智能社會:進退兩難》_IMDb

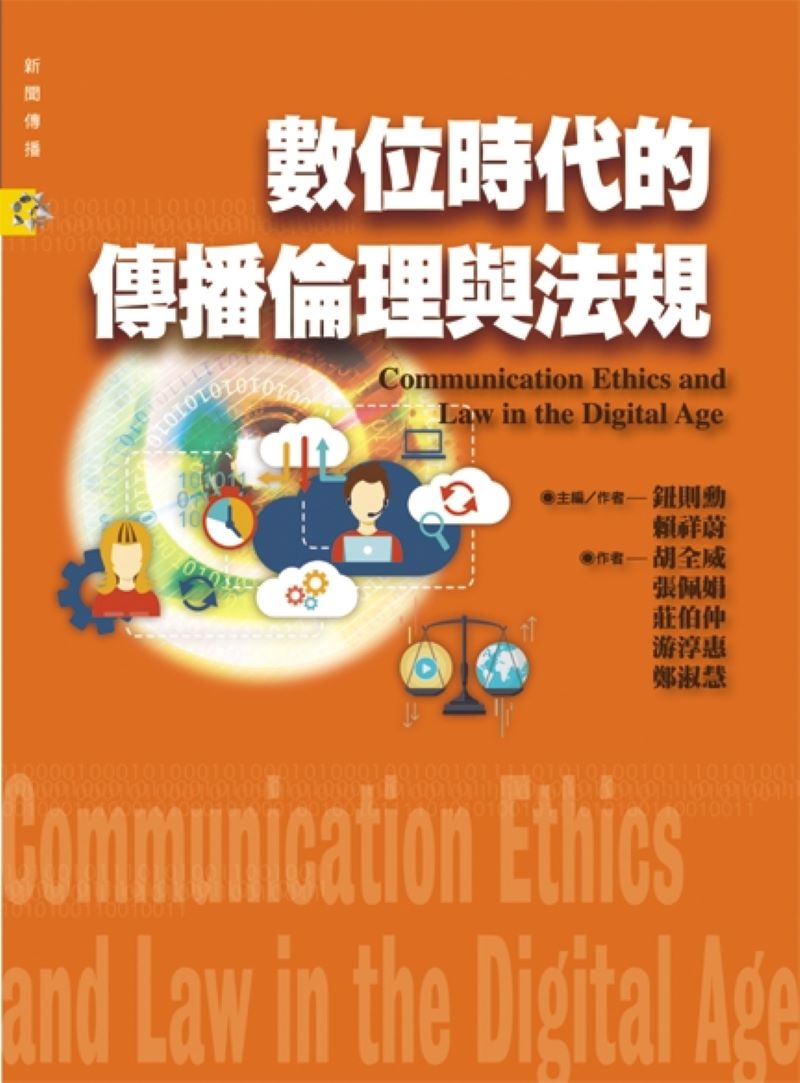

在數位時代,人工智慧(AI)已深入我們生活的各個層面。然而,AI應用不當可能會加劇無意識偏見,特別是在性別議題上。

一個引人深思的例子來自社交媒體平台Instagram,一位內容創作者thekingzletter分享了一個有趣的觀察:關於「女生抱怨男友遲到」的影片下,男性和女性用戶看到的熱門評論完全不同。

圖片來源:《社群網戰》_IMDb

圖片來源:《社群網戰》_IMDb

女性用戶看到的評論多是支持影片中的女生,如:「他不尊重你的時間,分手吧!」、「他有跟妳說他會晚到嗎?沒有的話放生吧!」;而男性用戶看到的評論則傾向支持男友,例如:「別整天等他,自己找點事做吧。」、「抱歉喔,我就是那個一起打高爾夫的朋友。」

令人震驚的是,這些言論幾乎都是處在對立的視角進行發言。

▌展開第二次工業革命

當代科技隨著AI的異軍突起,某種意義上來說就像是進入第二次工業革命時期,不論是哪個國家都依賴且關注其動向的局勢。

因此,人工智慧逐步擴展的同時,它所能改變的事情也遠比人類所想像的多,書中細細說明其所能夠改變戰爭走向、國際安全與人類自由的未來,甚至是如何維持在世界秩序中的領導地位。

該如何在這個充滿競爭與被人工智慧包覆的世界存活並占有優勢?本書帶領讀者一窺目前的現況,提供思考新方向。

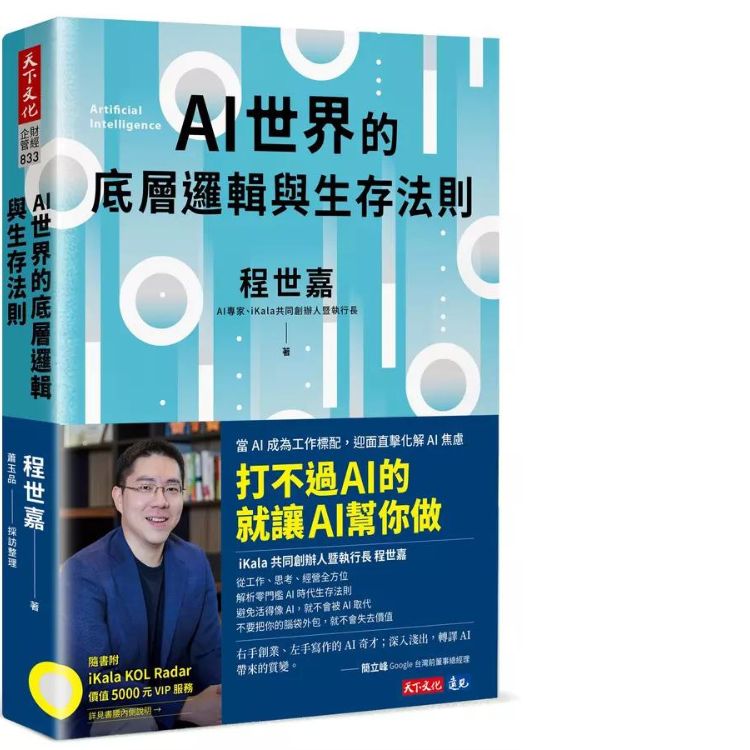

▌AI世界中的生存法則

當AI越來越發達的同時,也有多人擔憂工作職位在未來會輕易地被其取代,進而產生焦慮與不安。

但本書作者卻不這麼認為,他主張AI是一種便利的工具,因此若已身處在AI的時代,就想盡辦法與之共存,打造更高的成果和提升工作效率。

別使這項優秀的輔助工具成為你的焦慮來源,擁有自我主張,不輕易被掌控影響,才能發展只有你能做的能力,並發光發熱。

AI演算法帶來的影響與後果

圖片來源:《智能社會:進退兩難》_IMDb

圖片來源:《智能社會:進退兩難》_IMDb

因此,該篇貼文下有位機器學習研究者分享造成這個現象的原因為協同過濾(collaborative filtering),目的是最大化用戶的螢幕使用時間。

AI演算法根據每位用戶的使用習慣,顯示最可能吸引他們繼續瀏覽的評論。社交軟體環境中,協同過濾可能導致用戶只看到與自己觀點相似的評論。這種機制雖然提高了用戶參與度,卻也可能強化既有觀點,限制多元視角的接觸。

圖片來源:《社群網戰》_IMDb

圖片來源:《社群網戰》_IMDb

透過此案例的留言現象,我們也發現3點AI演算法會造成的現象如下:

1. 同溫層效應(Echo Chamber Effect):用戶可能只接收到符合自己既有觀點的訊息,減少接觸多元觀點的機會,可能加劇社會分裂。

2. 固有偏誤(inherent bias):如果AI的資料庫存在性別或文化偏見,這些偏見可能被無意識地強化和傳播。

3. 社會對立:長期的協同過濾與訊息隔離,可能導致不同群體之間的理解和溝通障礙,增加社會對立情緒。

▌看更多女人迷文章

如何不受演算法固定思考模式?

圖片來源:《社群網戰》_IMDb

圖片來源:《社群網戰》_IMDb

► 個人行為上:

定期進行「算法清理」:定期檢查並調整社交軟體和搜索引擎的設置,如清理瀏覽歷史、重置推薦算法,或使用隱私瀏覽模式,以減少同溫層效應。

► 組織行為上:

圖片來源:《社群網戰》_IMDb

圖片來源:《社群網戰》_IMDb

1. 建立多元共融的AI治理架構與組建多元化的AI開發團隊,確保不同背景的人才參與。

2. 制定明確的AI使用DEI指導原則,為員工提無意識偏見培訓,提高對潛在偏見的認識。

3. 設立AI倫理委員會或審核小組,實施持續的AI系統DEI評估,分析對不同群體的影響,及時調整系統以確保公平性。

✦